AIコーデインングでスキル17%低下!?テスト自動化のプロが解説

「AIに頼るほど、自分のスキルは大丈夫なのか」

Anthropicが現役エンジニア52名を対象に実施した実験が、この問いに答えを出しました。この研究結果をQA・テストエンジニアの視点で読み解き、そしてどのようにAIと向き合えばよいのかについて、MagicPodとしての考えをお伝えします。

目次

「Claude」の開発元Anthropicが実施した、現役エンジニアを対象にした実験

AIアシスタント「Claude」の開発元であるAnthropicの研究者が、2026年初頭に論文「How AI Impacts Skill Formation」を発表しました。

この研究では、現役のソフトウェアエンジニア52名を対象に「Trio」という非同期処理のPythonライブラリを使ったコーディング課題を与え、次の2グループに分けて実験しました。

▶参考:Shen, J. H., Tamkin, A. How AI Impacts Skill Formation

結果①:AIを使っても「速くならなかった」

まず驚くべき結果として、タスクの完了時間に統計的な意味のある差がなかったのです。

タスク完了時間

- AI支援あり群:約23分

- AI支援なし群:約24分

その主な理由は、AIへの質問に時間がかかったからです。参加者の中には、AIへの質問を15回以上行った方や、1つの質問を作成するのに6分以上費やした方もいました。AIが即座にコードを生成できる状態にあっても、「何を聞くか」「返ってきた答えをどう理解するか」に相当な時間が吸われていたのです。

結果②:スキルの習得は「17%低下」した

その一方、スキルの習得度では大きな差が生まれました。

課題後の理解度確認テストでは、AIを使ったグループのスコアが17%低いという結果が出ました。しかもこの差は、コーディング経験年数に関わらず、すべての経験レベルで観察されました。AIに慣れたベテランエンジニアでも、例外ではなかったということです。

また、3つの測定領域(概念理解・コード読解・デバッグ)の中で最も差が大きかったのは、デバッグ能力でした。AIがエラーを解消してくれるため、自力でエラーに向き合い、原因を突き止めるという経験そのものがなくなっていた結果、デバッグ力が育たなかったと研究は分析しています。

これは、テスト自動化の現場でも起きうる

この実験はプログラミング学習の話ですが、QAの現場に置き換えると、決して他人事ではありません。テスト自動化の領域ではこれまで、自動テストスクリプトの作成や実行結果の確認・分類といった「作業的なスキル」が重視されてきました。しかし現在、その多くを生成AIが代替し始めています。

一見すると効率化のように見えますが、ここで見落としてはいけないのが、スキルが育たなくなるリスクです。AIがテストコードを書き、エラーも解消してくれる環境では、自ら考え、原因を特定し、改善する経験が減っていきます。

ではこれからのQAは、何を身につけるべきなのでしょうか。単にAIを使いこなすだけではなく、「品質をどう担保するか」「どこにリスクがあるか」を判断できる力が、これまで以上に重要になります。

では、

- どのスキルを優先して伸ばすべきなのか

- AIとどう役割分担すべきなのか

- 組織としてどう取り組むべきなのか

これらは、どのように対応していく必要があるでしょうか?

このAI時代に求められる「判断力」を、テスト自動化のプロ目線で解説しました。

続きは以下の資料よりご確認ください。

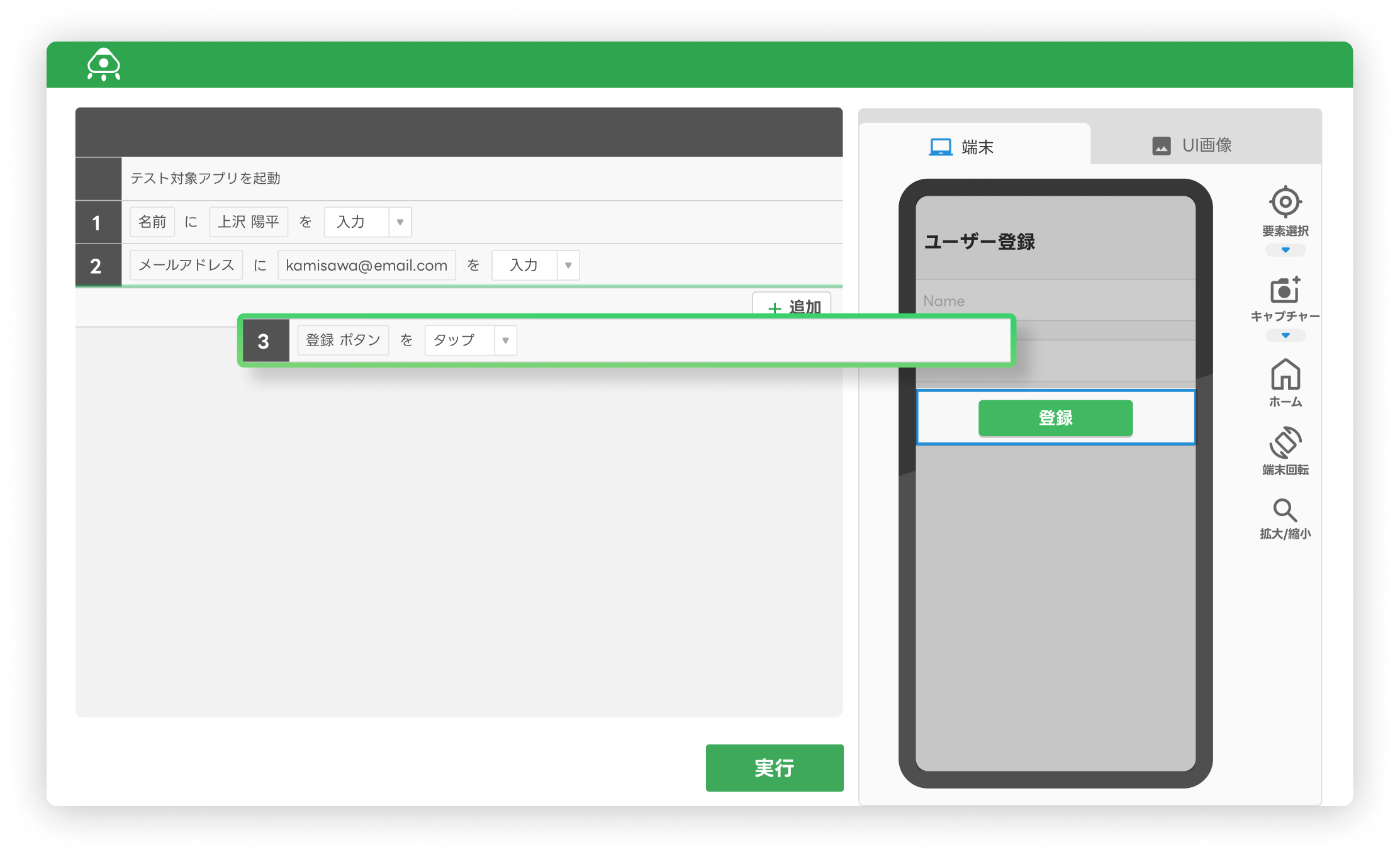

「わからない」は通用しない、脱AI依存 AI時代のQAに必要な「判断力」とは

500人以上へのレクチャー・20社以上の支援実績を持つプロが、AIとの付き合い方をQAの現場視点で解説。スキルを伸ばしながらAIを活かすための具体的な指針が手に入ります。

ダウンロード 無料